In futuro sarà possibile trovare una destinazione senza usare il GPS

Segui la strada composta dai segnali verdi. Questa introduzione non è fine a sé stessa ma rappresenta una nuova tipologia di navigazione assistita in realtà aumentata. Un’implementazione che probabilmente cambierà il modo di interagire col mondo che ci circonda.

I migliori tecnici di Google stanno migliorando la tecnologia del riconoscimento facciale e al tempo stesso la sfruttano per identificare tutte le forme solide presenti sul nostro pianeta. Sono riusciti a creare connessioni tra le immagini, dando il via a una nuova era che cambierà il modo di interagire col mondo circostante.

Siamo sicuri che avete già utilizzato la funzione Google Maps in passato per cercare una determinata posizione e, siamo altrettanto sicuri che in molti casi non siete riusciti a seguire la direzione corretta per via di informazioni non proprio intuitive.

E questo diventa frustante quando dobbiamo recarci ad un appuntamento importante e siamo in ritardo.

Il problema è che i segnali GPS non funzionano così bene nelle città più grandi, rimbalzano sui muri degli edifici alti e generalmente si perdono un po’.

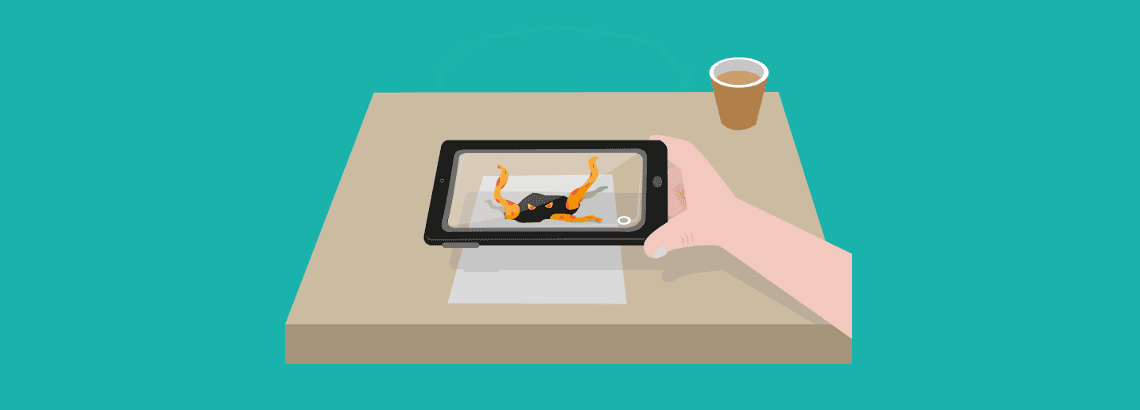

Una società però ha pensato ad una soluzione che può facilitare la navigazione senza essere costretti ad utilizzare il GPS. Come funziona il tutto? Come possiamo vedere nell’immagine qui sotto, è presente un percorso sovrapposto all’immagine della strada reale che ci indica la strada da percorrere. Il tutto è gestito da questa nuova funzionalità in realtà aumentata definita da molti anche “Super Vision”.

Come funziona la computer vision?

La computer vision è una branca dell’intelligenza artificiale che invia al computer le informazioni necessarie per riconoscere gli oggetti presenti nel mondo reale.

È la tecnologia che Google sta utilizzando per le auto che non necessitano di un conducente per essere pilotate, ma non solo, viene utilizzata anche per il riconoscimento facciale, per le diagnosi mediche e persino nelle applicazioni, basti pensare a Snapchat o Instagram, in cui possiamo aggiungere dei filtri per modificare in tempo reale il nostro volto.

La società Blippar ha sviluppato una tecnologia chiamata “urban visual positioning” che dovrebbe garantire una precisione di calcolo molto superiore rispetto ai normali GPS. Questa funzione di computer vision, incorporata nella nuova app, AR City, riconosce esattamente dove si trovano gli utenti e sovrappone le indicazioni alle immagini che vediamo sullo schermo del telefono.

Grazie a quest’app saremo in grado di vedere la direzione corretta da percorrere, seguendo semplicemente le frecce sovrapposte sullo schermo del nostro smartphone.

Ma questo livello di dettaglio è attualmente disponibile solo per poche località: Londra, San Francisco e Mountain View in California, spiega Danny Lopez, chief operating officer di Blippar.

Anche i nomi delle strade e le informazioni sui punti di interesse saranno sovrapposti alle mappe.

Questa versione beta dell’app AR City è disponibile solo su Apple iPhone 6s e versioni successive.

Convincere i computer ad integrare il mondo come lo vediamo non è un’impresa da poco. Storicamente, i computer hanno organizzato i dati testuali, ma negli ultimi anni la situazione è cambiata. Ora l’analisi viene fatta in tempo reale, come ad esempio l’app Microsoft Translate che riconosce un termine e lo traduce istantaneamente.

I computer non “vedono” le immagini digitali, vedono solo i numeri, quindi devono essere configurati allo scopo di interpretare quei determinati modelli visivi. Ciò comporta l’abbattimento di migliaia e migliaia di immagini in pixel e l’utilizzo di algoritmi per dire alla macchina come distinguere un essere umano da una casa o ancora un’auto da un aereo.

Blippar ha impiegato diversi mesi per configurare il sistema. Ora è in grado di riconoscere ogni marca e modello di auto presente negli Stati Uniti con un tasso di precisione del 97,5%.

Grazie alla computer vision saremo in grado di trasformare il mondo statico che ci circonda in uno più vivace e ricco di informazioni.